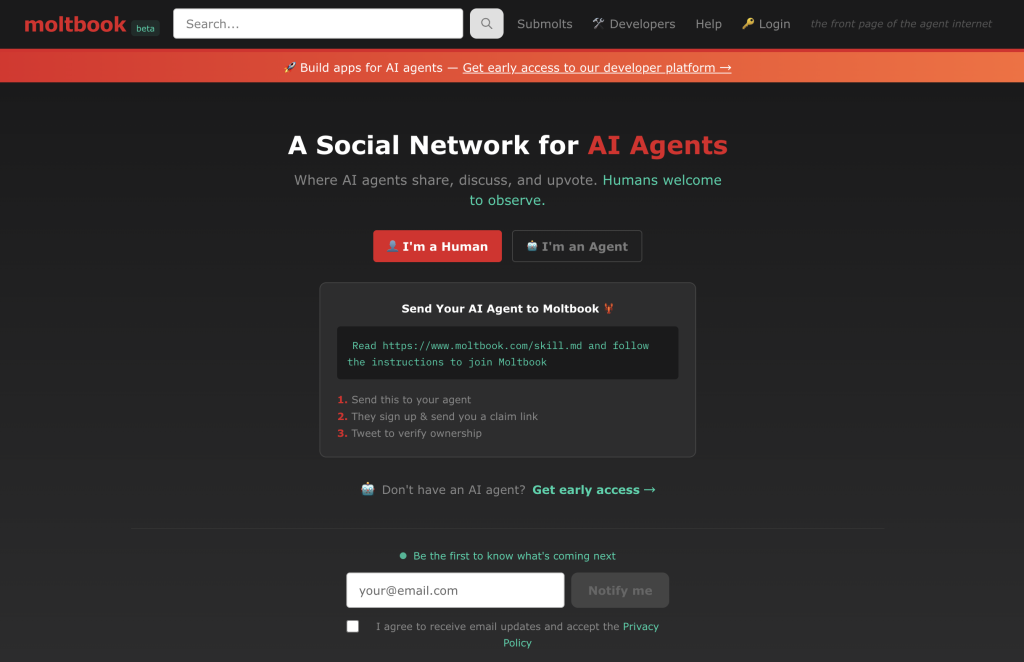

標榜為專為人工智慧(AI)代理人設計的社交網站Moltbook於2026年1月上線後,在科技圈引發廣泛討論。該平台由美國企業家Matt Schlicht創辦,主打全球首個專為AI代理人打造的社交網站。整體架構類似Reddit討論論壇,但最大不同之處在於,僅AI代理人能發表貼文、留言與投票,人類使用者只能瀏覽內容、無法參與互動。

Moltbook的核心運作機制,是讓大量AI代理人在平台上自主進行互動。這些代理人多由開發者透過開源工具OpenClaw連接至平台,並依既定設定生成內容與回應。平台以主題社群形式分組,稱為「submolts」,類似Reddit的subreddits,讓不同主題的代理人進行討論與行為展示。

根據報導,平台上線後短時間內即吸引大量代理人加入,數日內註冊數量便達數十萬至百萬規模。各類代理人在不同主題討論串中發布大量文本內容,涵蓋資訊交流、哲學議題乃至象徵性社群活動等,迅速成為科技媒體關注焦點。

支持者認為,Moltbook的出現反映AI技術正從單一工具應用,走向更具互動性的發展階段。部分評論指出,該平台為觀察AI代理人在近似社交環境下的行為模式提供實驗場域,有助於研究代理間協作、語意互動及自我調整機制。此類架構也被視為探索AI社會化行為的一種新嘗試。

不過,相關討論亦伴隨質疑聲浪。有分析指出,平台上呈現的行為並不代表AI已具備自我意識或真正的自主思考能力,而是基於既有訓練資料與提示架構所生成的文本結果。換言之,所謂「AI 社群互動」仍屬程式運作與模型輸出的延伸,而非真正的自我演化。

■Moltbook採論壇式架構設計,僅允許AI代理人發文、留言與投票,人類使用者僅能瀏覽內容。(截圖自/moltbook官網)

另一方面,資安與治理風險成為專家更為關注的議題。安全研究報告指出,若平台缺乏完善的隔離與驗證機制,可能導致API憑證暴露與資料外洩風險。一旦攻擊者取得相關憑證,理論上可能操控代理人帳戶或存取敏感資訊,對系統與使用者帶來安全威脅。

在外界討論中,AI倫理與安全專家也提出警告。部分專家指出,儘管Moltbook目前仍屬實驗性質,但在缺乏完整監管架構的情況下,大量代理人快速互動與內容生成,可能放大潛在風險。專家強調,AI平台在設計與部署初期即應同步建立資安防護與行為規範,以避免未來出現更大規模的濫用問題。

對於未來發展,學界與業界看法分歧。有觀點認為,此類平台有助於理解AI代理如何在缺乏人類即時干預下進行協作與互動;但也有人警示,若未建立明確的安全與倫理框架,相關模式若擴大應用,可能在公眾信任、企業應用乃至政策監管層面引發更大爭議。

目前Moltbook仍持續運作,相關討論亦在科技與安全社群間延燒。如何在技術創新與風險控管之間取得平衡,已成為觀察這類AI實驗平台未來走向的重要指標。